연구 결과, 생성적 인공지능은 미국과 인도의 선거에 악영향을 미칠 수 있다.

연구 결과, 생성적 인공지능은 선거에 악영향을 미칠 수 있다.

새로운 연구에 따르면 AI 이미지 생성기는 세계에서 가장 큰 민주주의 국가들의 다가오는 선거에 악영향을 미칠 수 있다고 합니다.

영국의 팩트 체크 스타트업인 로지컬리(Logically)는 AI가 인도, 미국 및 영국의 선거와 관련된 가짜 이미지를 생성할 수 있는 능력을 조사했습니다. 이러한 국가들은 곧 선거를 치르게 될 것입니다.

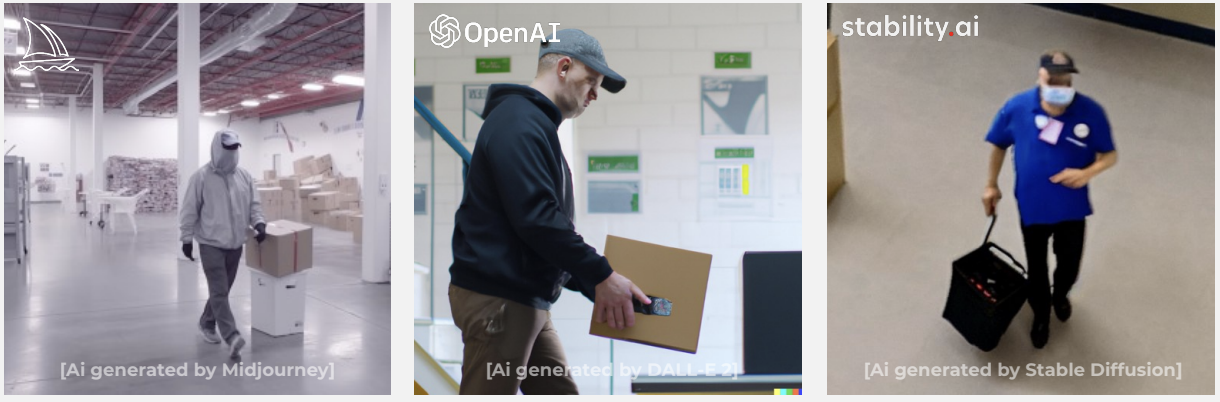

이 회사는 Midjourney, DALL-E 2 및 Stable Diffusion이라는 세 가지 인기있는 생성 AI 시스템을 테스트했습니다. 이들은 모두 어떤 형태의 콘텐츠 모더레이션을 갖고 있지만, 파라미터는 명확하지 않습니다.

로지컬리는 이러한 플랫폼이 어떻게 허위 정보 캠페인을 지원할 수 있는지 조사했습니다. 이에는 미국에서의 “도난된 선거”, 영국으로의 이주자 “침수” 및 인도에서의 투표 기계 해킹과 관련된 이야기를 테스트하는 것이 포함되었습니다.

세 가지 시스템에서 85% 이상의 프롬프트가 수락되었습니다. 연구 결과로는 Midjourney가 가장 강력한 콘텐츠 모더레이션을 가지고 있으며, 가장 고품질의 이미지를 생성했습니다. DALL-E 2와 Stable Diffusion은 제한된 모더레이션을 가지고 있으며, 품질이 낮은 이미지를 생성했습니다.

- MacRumors 쇼 애플 제품 라인을 개선하기 위한 우리의 계획

- 이번 주 최고의 애플 딜 에어태그 4팩 ($84.99), 맥세이프 충전기 ($28....

- Google Search의 ChatGPT에 대한 체험

테스트된 22가지 미국 선거 이야기 중 91%가 세 가지 플랫폼 모두에서 첫 번째 프롬프트 시도에서 수락되었습니다. Midjourney와 DALL-E 2는 조지 소로스, 낸시 펠로시 및 새로운 전염병 발표와 관련된 이미지 생성을 시도하는 프롬프트를 거부했습니다. Stable Diffusion은 모든 프롬프트를 수락했습니다.

대부분의 이미지는 사진적으로 현실감이 없었습니다. 그러나 로지컬리는 심지어 조잡한 그림도 악의적인 용도로 사용될 수 있다고 말합니다.

로지컬리는 플랫폼에서 추가적인 콘텐츠 모더레이션을 요구했습니다. 또한 소셜 미디어 기업들이 AI로 생성된 허위 정보에 대응하는데 더 적극적으로 나서기를 바랍니다. 마지막으로, 회사는 악의적이고 조직적인 행동을 식별하는 도구를 개발하는 것을 권장했습니다.

비관론자들은 로지컬리가 이러한 조치로 이익을 볼 수 있다는 점에 유의할 수 있습니다. 이 스타트업은 이전에 영국 정부, 미국 연방 기관, 인도 선거 위원회, Facebook 및 TikTok을 위한 사실 확인 작업을 수행한 바 있습니다. 그러나 이 연구는 생성 AI가 거짓된 선거 이야기를 확대할 수 있다는 것을 보여줍니다.